AnythingLLM + RAG:プライベートナレッジベース構築の究極ガイド

AnythingLLMとRAGを使用したプライベートナレッジベース構築の完全チュートリアル。ベクターデータベース、ドキュメントチャンキング、エンタープライズデプロイメントを解説

AnythingLLM + RAG:プライベートナレッジベース構築の究極ガイド

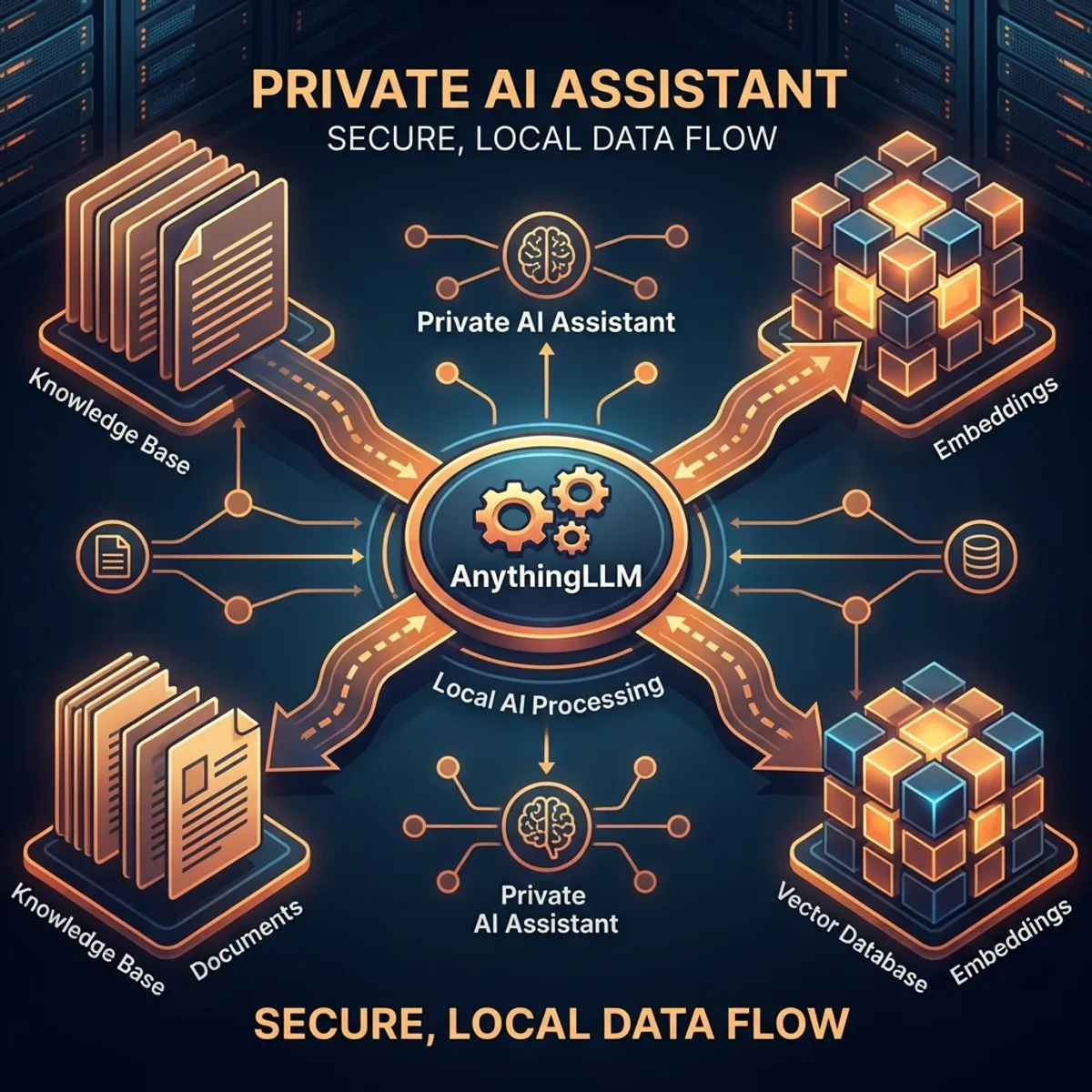

2026年、プライバシーファーストのAIはもはやオプションではなく必須となりました。AnythingLLMは、データをローカルに保ちながら最新のLLMの力を活用するプライベートナレッジベース構築のための主要なオープンソースソリューションとして台頭しています。この包括的なガイドでは、ゼロから本番対応のRAGシステムを構築します。

AnythingLLMとは?

AnythingLLMは以下のためのオールインワンアプリケーションです:

- プライベートドキュメントチャット - 外部APIにデータを送信せず

- マルチモデルサポート(Ollama、OpenAI、Anthropic、ローカルモデル)

- ベクターデータベース統合 - セマンティック検索用

- エンタープライズ機能(ユーザー、権限、ワークスペース)

主要機能

| 機能 | 説明 |

|---|---|

| 100%ローカル | 完全にあなたのハードウェアで実行 |

| マルチLLM | OpenAI、Claude、Ollama、LM Studio |

| RAGパイプライン | 組み込みドキュメント処理 |

| ベクターDB | LanceDB、Chroma、Pinecone、Weaviate |

| エージェント | カスタムツールとワークフロー |

| APIアクセス | OpenAI互換エンドポイント |

RAGアーキテクチャの理解

RAGとは?

**検索拡張生成(RAG)**は以下の方法でLLMの応答を強化します:

ユーザークエリ

│

▼

┌─────────────────┐

│ 埋め込み │ ← クエリをベクトルに変換

│ モデル │

└─────────────────┘

│

▼

┌─────────────────┐

│ ベクター │ ← 類似ドキュメントを検索

│ データベース │

└─────────────────┘

│

▼

┌─────────────────┐

│ コンテキスト + │ ← 検索されたドキュメントを

│ クエリ │ 元のクエリと組み合わせ

└─────────────────┘

│

▼

┌─────────────────┐

│ LLM │ ← 情報に基づいた応答を生成

└─────────────────┘

│

▼

応答RAGとファインチューニングの比較

| 側面 | RAG | ファインチューニング |

|---|---|---|

| データの鮮度 | リアルタイム | スナップショット |

| コスト | 低 | 高 |

| 必要な専門知識 | 中程度 | 高 |

| ハルシネーション制御 | 良好 | 中程度 |

| 最適用途 | 動的知識 | 動作変更 |

インストールガイド

オプション1:デスクトップアプリ(初心者推奨)

# 公式サイトからダウンロード

# macOS、Windows、Linux対応

# https://anythingllm.com/downloadオプション2:Docker(本番環境推奨)

# 公式イメージをプル

docker pull mintplexlabs/anythingllm

# 永続ストレージで実行

docker run -d \

--name anythingllm \

-p 3001:3001 \

-v ~/.anythingllm:/app/server/storage \

-e STORAGE_DIR=/app/server/storage \

mintplexlabs/anythingllmオプション3:ソースから

git clone https://github.com/Mintplex-Labs/anything-llm.git

cd anything-llm

# 依存関係をインストール

yarn setup

# 開発サーバーを起動

yarn dev最初のワークスペースの設定

ステップ1:LLMを選択

設定 → LLMプリファレンスに移動:

| プロバイダー | 最適用途 | セットアップ |

|---|---|---|

| Ollama | ローカル、プライバシー | Ollamaをインストール、モデルをプル |

| OpenAI | 品質、速度 | APIキー |

| Anthropic | コーディング、安全性 | APIキー |

| LM Studio | ローカル、GUI | アプリをインストール、モデルをロード |

Ollamaセットアップ例:

# Ollamaをインストール

curl -fsSL https://ollama.com/install.sh | sh

# モデルをプル

ollama pull llama3.2:latest

# 実行を確認

ollama listステップ2:埋め込みモデルを選択

RAGには埋め込みモデルが必要:

| モデル | プロバイダー | 品質 | 速度 |

|---|---|---|---|

| text-embedding-3-large | OpenAI | 最高 | 高速 |

| nomic-embed-text | Ollama | 非常に良い | 中程度 |

| all-MiniLM-L6-v2 | ローカル | 良い | 高速 |

| bge-large-en | ローカル | 非常に良い | 中程度 |

ステップ3:ベクターデータベースを選択

| データベース | ストレージ | 最適用途 |

|---|---|---|

| LanceDB | ローカル | デフォルト、シンプル |

| Chroma | ローカル | 開発 |

| Pinecone | クラウド | スケーラビリティ |

| Weaviate | どちらも | エンタープライズ |

| QDrant | どちらも | パフォーマンス |

ドキュメント処理のベストプラクティス

サポートされるファイルタイプ

ドキュメント:

├── PDF (.pdf)

├── Word (.docx, .doc)

├── テキスト (.txt, .md)

├── CSV/Excel (.csv, .xlsx)

└── コードファイル (.py, .js, .ts など)

ウェブ:

├── URL(自動スクレイピング)

├── YouTube(トランスクリプト)

└── GitHubリポジトリチャンキング戦略

チャンキングはRAG品質に直接影響:

// デフォルト設定(ほとんどのケースに対応)

{

chunkSize: 1000, // チャンクあたりの文字数

chunkOverlap: 200, // チャンク間のオーバーラップ

splitter: "sentence" // 文の境界で分割

}

// 技術ドキュメント用

{

chunkSize: 1500,

chunkOverlap: 300,

splitter: "markdown" // Markdownヘッダーを尊重

}

// コードリポジトリ用

{

chunkSize: 2000,

chunkOverlap: 500,

splitter: "code" // 関数の境界を尊重

}前処理のヒント

-

アップロード前にドキュメントをクリーン

- PDFからヘッダー/フッターを削除

- OCRエラーを修正

- フォーマットを標準化

-

メタデータを追加して検索を改善

- ドキュメントタイトル

- 作成日

- カテゴリ/タグ

-

本番前に検索をテスト

- 期待される質問でクエリ

- 正しいチャンクが返されることを確認

高度なRAG設定

1. ハイブリッド検索

セマンティック検索とキーワード検索を組み合わせ:

// ワークスペース設定

{

searchMode: "hybrid",

semanticWeight: 0.7,

keywordWeight: 0.3

}2. リランキング

クロスエンコーダーリランキングで結果品質を向上:

// リランキングを有効化

{

reranker: "cohere", // または "cross-encoder"

rerankerTopN: 5, // リランキング後トップ5を選択

initialRetrieve: 20 // 20件取得、5件にリランク

}3. マルチクエリ拡張

複数のクエリを生成してリコールを向上:

// クエリ拡張設定

{

multiQuery: true,

expansionCount: 3, // 3つのクエリバリエーションを生成

aggregation: "union" // 結果を統合

}エンタープライズドキュメントQ&Aシステムの構築

アーキテクチャ概要

┌────────────────────────────────────┐

│ AnythingLLM │

├────────────────────────────────────┤

│ ワークスペース:エンジニアリングドキュメント │

│ ├── APIドキュメント │

│ ├── コーディング規約 │

│ └── アーキテクチャ決定 │

├────────────────────────────────────┤

│ ワークスペース:HRポリシー │

│ ├── 従業員ハンドブック │

│ ├── 福利厚生ガイド │

│ └── オンボーディング資料 │

├────────────────────────────────────┤

│ ベクターDB:LanceDB(ローカル) │

│ LLM:Ollama(llama3.2) │

│ 埋め込み:nomic-embed-text │

└────────────────────────────────────┘API統合

OpenAI互換API

import openai

# AnythingLLMを指定

client = openai.OpenAI(

base_url="http://localhost:3001/api/v1",

api_key="your-anythingllm-api-key"

)

# ワークスペースコンテキストでチャット

response = client.chat.completions.create(

model="gpt-4", # 設定されたLLMにルーティング

messages=[

{"role": "user", "content": "コーディング規約は何ですか?"}

],

extra_body={

"workspace_slug": "engineering-docs"

}

)

print(response.choices[0].message.content)パフォーマンス最適化

ハードウェア推奨

| ユースケース | RAM | GPU | ストレージ |

|---|---|---|---|

| 個人 | 16GB | オプション | SSD 50GB |

| チーム(10人) | 32GB | 8GB VRAM | SSD 200GB |

| エンタープライズ | 64GB+ | 24GB VRAM | NVMe 1TB |

まとめ

AnythingLLM + RAGはプライベートナレッジ管理の強力な基盤を提供:

✅ 完全なプライバシー - データがシステムを離れない ✅ 柔軟なLLM選択 - 好みのモデルを使用 ✅ エンタープライズ対応 - ユーザー、権限、ワークスペース ✅ 開発者フレンドリー - OpenAI互換API

今すぐプライベートナレッジベースの構築を始めましょう!

FAQ

Q:インターネットなしでAnythingLLMを使用できますか? A:はい、Ollamaとローカル埋め込みで完全にオフラインで実行できます。

Q:どれくらいのデータを処理できますか? A:数百万のドキュメントでテスト済み;LanceDBはスケールします。

Q:医療/法律データに適していますか? A:はい、適切なローカルデプロイメントとセキュリティ対策を施せば。

Q:複数のユーザーが同じワークスペースにアクセスできますか? A:はい、ユーザー管理とロールベースの権限で。

Q:ドキュメントを更新するには? A:削除して再アップロード、またはドキュメント同期機能を使用。

AnythingLLMでRAGシステムを構築しましたか?体験を共有してください!