LlamaIndex 2026:プライベートAIナレッジベース(RAG)を構築する

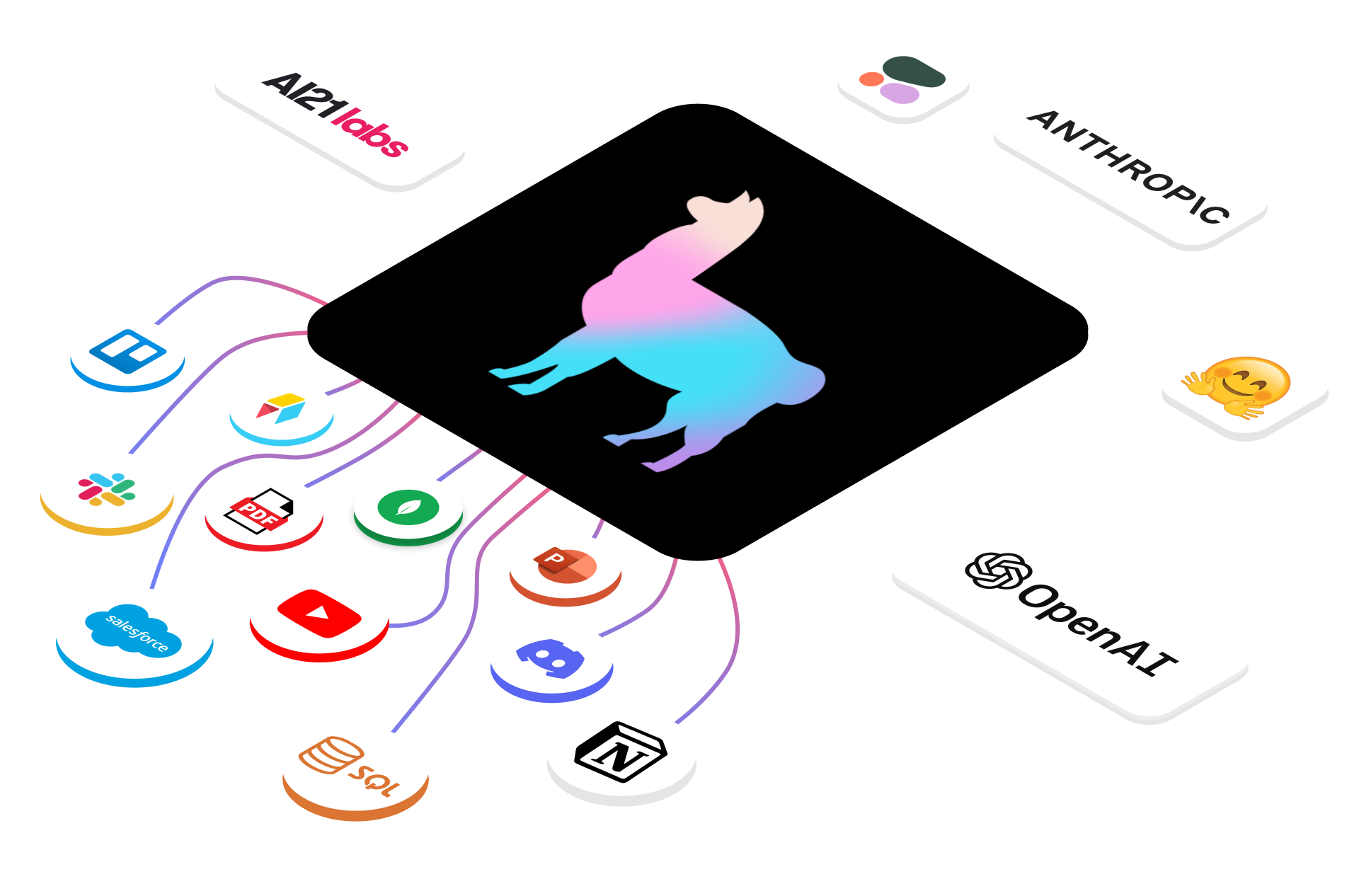

データ接続以上のもの—LlamaIndexはRAGアプリケーションの究極のフレームワーク。PDFからSQLデータベースクエリまで、AIにデータを真に理解させる。

LangChainがスイスアーミーナイフなら、LlamaIndexは精密な外科器具です—特にデータの操作において。

RAG(Retrieval-Augmented Generation)アプリケーションを構築する際、効率的なデータの処理、インデックス作成、検索が最大の課題です。LlamaIndex(旧GPT Index)はこれに特化しており、LLMがメモリを読むようにプライベートデータ(PDF、Notion、SQL、API)を読めるようにします。

LlamaIndexとは?

LlamaIndexは、カスタムデータソースを大規模言語モデルに接続するためのデータフレームワークです。

3つの核心的な問題を解決:

- 取り込み: 多様なデータ(Larkドキュメント、Slack記録、PDF)をどう取り込むか?

- インデックス作成: このデータをどう分割、ベクター化、保存するか?

- クエリ: 大量のデータからAIが必要とする正確なセグメントをどう見つけるか?

環境セットアップ

1. インストール

pip install llama-index2. OpenAIキーを設定

LlamaIndexはデフォルトでOpenAIのエンベディングモデルとLLMを使用します。

export OPENAI_API_KEY="sk-proj-xxxxxxxx"ハンズオン:5行のコードで「PDFとチャット」

sample.pdf(製品マニュアルなど)があり、AIにそれに基づいて質問に答えさせたいとします。

dataというフォルダを作成し、sample.pdfを入れます。- Pythonスクリプトを書きます:

from llama_index.core import VectorStoreIndex, SimpleDirectoryReader

# 1. データを読み込み

documents = SimpleDirectoryReader("data").load_data()

# 2. インデックスを構築(自動分割、エンベッド、メモリに保存)

index = VectorStoreIndex.from_documents(documents)

# 3. クエリエンジンを作成

query_engine = index.as_query_engine()

# 4. 質問する

response = query_engine.query("このマニュアルに記載されている保証期間は?")

print(response)何が起こったか?

SimpleDirectoryReaderがPDFテキストを自動解析。VectorStoreIndexがOpenAI Embedding APIを呼び出してテキストをベクターに変換。queryはまずベクターストアで最も類似した段落を検索し、その段落+質問をGPT-4にパッケージ化し、最終的に回答を生成。

上級編:Agentic RAG

2026年、RAGはもはや単純な「検索して回答」ではなく—推論能力を持つAgentです。LlamaIndexは強力なAgentインターフェースを提供します。

シナリオを想像してください:複雑な財務レポートを分析する必要があります。通常のRAGはドキュメント分割の断片化により誤った回答を与える可能性があります。LlamaIndexのReAct Agentは:

- まず「2025年第4四半期の収益」を検索。

- データがテーブルにあることを発見し、「Pandas Query Engine」ツールを呼び出す。

- 成長率を計算。

- 結論を統合。

from llama_index.core.agent import ReActAgent

from llama_index.core.tools import FunctionTool

# 計算ツールを定義

def time_travel_tax_calculator(year: int, income: float) -> float:

"""将来の税金を計算"""

if year > 2030:

return income * 0.5

return income * 0.2

tool = FunctionTool.from_defaults(fn=time_travel_tax_calculator)

# Agentを作成

agent = ReActAgent.from_tools([tool, ...], verbose=True)

agent.chat("2032年に100万稼いだら、税金はいくら払いますか?")LangChainではなくLlamaIndexを選ぶ理由

相互排他ではなく—よく一緒に使われます。しかし、アプリケーションがデータ重視(例:数百万のドキュメント処理、複雑なナレッジグラフ検索)の場合、LlamaIndexの高度な検索戦略(階層インデックス、センテンスウィンドウ検索など)はLangChainのデフォルトよりもはるかに優れたパフォーマンスを発揮します。

まとめ

- LangChain: ワークフローオーケストレーションに優れ、高い汎用性。

- LlamaIndex: データRAGに優れ、高い検索精度。

推奨: データのインデックス作成と検索にはLlamaIndexを使用し、より高レベルのインタラクションロジックにはLangChain(またはLlamaIndexネイティブAgent)を使用。

データが資産であるこの時代、LlamaIndexはデータの金を掘り起こすためのシャベルです。