AnythingLLM + RAG:打造私有知识库终极指南

使用AnythingLLM和RAG构建私有知识库的完整教程。涵盖向量数据库、文档分块策略和企业级部署

AnythingLLM + RAG:打造私有知识库终极指南

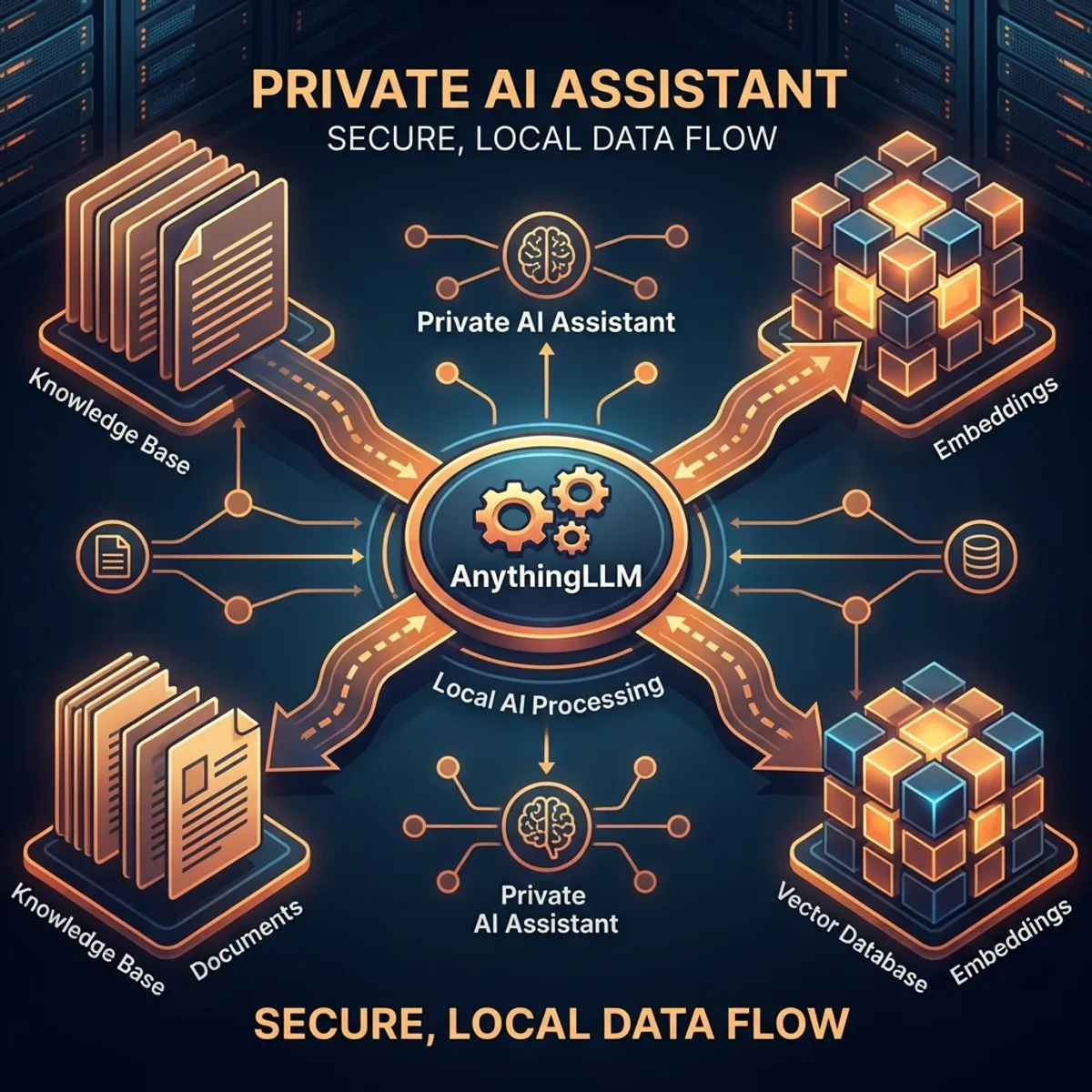

2026年,隐私优先的AI已不再是可选项——而是必需。AnythingLLM已成为构建私有知识库的领先开源解决方案,让你的数据留在本地,同时发挥现代LLM的强大能力。本指南将带你从零构建生产级RAG系统。

什么是AnythingLLM?

AnythingLLM是一站式应用,支持:

- 私有文档对话,无需向外部API发送数据

- 多模型支持(Ollama、OpenAI、Anthropic、本地模型)

- 向量数据库集成,实现语义搜索

- 企业功能(用户、权限、工作区)

核心特性

| 特性 | 说明 |

|---|---|

| 100%本地 | 完全在你的硬件上运行 |

| 多LLM | OpenAI、Claude、Ollama、LM Studio |

| RAG流水线 | 内置文档处理 |

| 向量数据库 | LanceDB、Chroma、Pinecone、Weaviate |

| Agent | 自定义工具和工作流 |

| API访问 | OpenAI兼容端点 |

理解RAG架构

什么是RAG?

**检索增强生成(RAG)**通过以下方式增强LLM响应:

用户查询

│

▼

┌─────────────────┐

│ 嵌入模型 │ ← 将查询转换为向量

└─────────────────┘

│

▼

┌─────────────────┐

│ 向量数据库 │ ← 查找相似文档

└─────────────────┘

│

▼

┌─────────────────┐

│ 上下文 + │ ← 将检索到的文档

│ 查询 │ 与原始查询组合

└─────────────────┘

│

▼

┌─────────────────┐

│ LLM │ ← 生成有依据的回答

└─────────────────┘

│

▼

响应RAG vs 微调

| 维度 | RAG | 微调 |

|---|---|---|

| 数据时效性 | 实时 | 快照 |

| 成本 | 低 | 高 |

| 专业要求 | 中等 | 高 |

| 幻觉控制 | 更好 | 一般 |

| 适用场景 | 动态知识 | 行为改变 |

安装指南

方式1:桌面应用(新手推荐)

# 从官网下载

# 支持macOS、Windows、Linux

# https://anythingllm.com/download方式2:Docker(生产环境推荐)

# 拉取官方镜像

docker pull mintplexlabs/anythingllm

# 运行并持久化存储

docker run -d \

--name anythingllm \

-p 3001:3001 \

-v ~/.anythingllm:/app/server/storage \

-e STORAGE_DIR=/app/server/storage \

mintplexlabs/anythingllm方式3:源码编译

git clone https://github.com/Mintplex-Labs/anything-llm.git

cd anything-llm

# 安装依赖

yarn setup

# 启动开发服务器

yarn dev配置首个工作区

步骤1:选择LLM

进入设置 → LLM偏好:

| 提供商 | 最适场景 | 配置 |

|---|---|---|

| Ollama | 本地、隐私 | 安装Ollama,拉取模型 |

| OpenAI | 质量、速度 | API密钥 |

| Anthropic | 编程、安全 | API密钥 |

| LM Studio | 本地、GUI | 安装应用,加载模型 |

Ollama配置示例:

# 安装Ollama

curl -fsSL https://ollama.com/install.sh | sh

# 拉取模型

ollama pull llama3.2:latest

# 验证运行

ollama list步骤2:选择嵌入模型

RAG需要嵌入模型:

| 模型 | 提供商 | 质量 | 速度 |

|---|---|---|---|

| text-embedding-3-large | OpenAI | 最佳 | 快 |

| nomic-embed-text | Ollama | 很好 | 中 |

| all-MiniLM-L6-v2 | 本地 | 好 | 快 |

| bge-large-zh | 本地 | 很好(中文) | 中 |

步骤3:选择向量数据库

| 数据库 | 存储 | 最适场景 |

|---|---|---|

| LanceDB | 本地 | 默认,简单 |

| Chroma | 本地 | 开发 |

| Pinecone | 云端 | 可扩展性 |

| Weaviate | 均可 | 企业级 |

| QDrant | 均可 | 性能 |

文档处理最佳实践

支持的文件类型

文档:

├── PDF (.pdf)

├── Word (.docx, .doc)

├── 文本 (.txt, .md)

├── CSV/Excel (.csv, .xlsx)

└── 代码文件 (.py, .js, .ts等)

网页:

├── URL(自动抓取)

├── YouTube(字幕)

└── GitHub仓库分块策略

分块直接影响RAG质量:

// 默认设置(适用大多数场景)

{

chunkSize: 1000, // 每块字符数

chunkOverlap: 200, // 块间重叠

splitter: "sentence" // 按句子边界分割

}

// 技术文档

{

chunkSize: 1500,

chunkOverlap: 300,

splitter: "markdown" // 尊重Markdown标题

}

// 代码仓库

{

chunkSize: 2000,

chunkOverlap: 500,

splitter: "code" // 尊重函数边界

}预处理技巧

-

上传前清理文档

- 移除PDF的页眉页脚

- 修复OCR错误

- 统一格式

-

添加元数据提升检索效果

- 文档标题

- 创建日期

- 类别/标签

-

上线前测试检索

- 用预期问题查询

- 验证返回正确的文档块

高级RAG配置

1. 混合搜索

结合语义搜索和关键词搜索:

// 工作区设置

{

searchMode: "hybrid",

semanticWeight: 0.7,

keywordWeight: 0.3

}2. 重排序

使用交叉编码器重排序提升结果质量:

// 启用重排序

{

reranker: "cohere", // 或 "cross-encoder"

rerankerTopN: 5, // 重排后选取Top 5

initialRetrieve: 20 // 先检索20条,重排到5条

}3. 多查询扩展

生成多个查询提升召回率:

// 查询扩展设置

{

multiQuery: true,

expansionCount: 3, // 生成3个查询变体

aggregation: "union" // 合并结果

}构建企业级文档问答系统

架构概览

┌────────────────────────────────────┐

│ AnythingLLM │

├────────────────────────────────────┤

│ 工作区:技术文档 │

│ ├── API文档 │

│ ├── 代码规范 │

│ └── 架构决策 │

├────────────────────────────────────┤

│ 工作区:HR政策 │

│ ├── 员工手册 │

│ ├── 福利指南 │

│ └── 入职材料 │

├────────────────────────────────────┤

│ 向量数据库:LanceDB(本地) │

│ LLM:Ollama(llama3.2) │

│ 嵌入:nomic-embed-text │

└────────────────────────────────────┘实施步骤

- 为每个部门创建工作区

- 按组织结构上传文档

- 配置权限(谁可以访问什么)

- 设置API与其他工具集成

- 监控使用情况并根据查询优化

API集成

OpenAI兼容API

import openai

# 指向AnythingLLM

client = openai.OpenAI(

base_url="http://localhost:3001/api/v1",

api_key="your-anythingllm-api-key"

)

# 带工作区上下文对话

response = client.chat.completions.create(

model="gpt-4", # 路由到你配置的LLM

messages=[

{"role": "user", "content": "我们的代码规范是什么?"}

],

extra_body={

"workspace_slug": "engineering-docs"

}

)

print(response.choices[0].message.content)直接API调用

# 查询工作区

curl -X POST http://localhost:3001/api/v1/workspace/engineering/chat \

-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"message": "我们的API版本管理策略是什么?",

"mode": "query"

}'性能优化

1. 缓存策略

// 启用响应缓存

{

cacheEnabled: true,

cacheTTL: 3600, // 1小时

cacheStrategy: "semantic" // 缓存相似查询

}2. 批量处理

# 批量处理文档

for file in $(ls documents/); do

curl -X POST http://localhost:3001/api/v1/workspace/upload \

-H "Authorization: Bearer $API_KEY" \

-F "file=@documents/$file"

sleep 1 # 限流

done3. 硬件建议

| 场景 | 内存 | GPU | 存储 |

|---|---|---|---|

| 个人 | 16GB | 可选 | SSD 50GB |

| 团队(10人) | 32GB | 8GB显存 | SSD 200GB |

| 企业 | 64GB+ | 24GB显存 | NVMe 1TB |

总结

AnythingLLM + RAG为私有知识管理提供强大基础:

✅ 完全隐私 — 数据永不离开你的系统 ✅ 灵活选择LLM — 使用任何你偏好的模型 ✅ 企业就绪 — 用户、权限、工作区 ✅ 开发者友好 — OpenAI兼容API

现在就开始构建你的私有知识库!

常见问题

Q:可以离线使用AnythingLLM吗? A:可以,配合Ollama和本地嵌入,完全离线运行。

Q:能处理多少数据? A:经测试可处理数百万文档;LanceDB扩展性良好。

Q:适合医疗/法律数据吗? A:适合,需要正确的本地部署和安全措施。

Q:多用户能访问同一工作区吗? A:可以,通过用户管理和基于角色的权限。

Q:如何更新文档? A:删除并重新上传,或使用文档同步功能。

你用AnythingLLM构建过RAG系统吗?欢迎分享经验!